| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- Bag-of-Words

- 자연어 처리 기법

- sqld

- 데이터 결측치

- 논문초록

- list

- C++

- SQLD 벼락치기

- 데이터 시각화

- 스택에 배열 푸시하기

- Collection if

- DeepSpeed

- tail()

- pytorch zero to all

- 자연어 처리의 모든것

- 비전공자 빅분기 합격

- 파인튜닝 메모리 해결

- 챗지피티와 업무자동화

- head()

- 아이리포

- AI

- Naive Bayes Classifier for Document Classification

- inplace=True

- Til

- Python

- colab

- llm

- interpolate()

- sklearn.ensemble

- BoostCourse

- Today

- Total

hyerong's Dev_world🎡

AI실습 과제 기록: data set, unique value, tree by python 본문

최초 작성 일자 : 2021년 7월 9일 23시 56분

당시 수강신청 실수?로 컴공 신입일때 들은 3학년 수업..

그때의 열정과 이해에 대한 집착ㅠ을 기억하며 다시 파이썬 공부를 시작해야겠다.

당시엔 unique value를 이해하기도 힘들었는데 다시 돌아보니 감회가 새롭다.

지난 1학기, 수강신청 실수로 수강한 한 학년 위 수업이었던 AI 프로젝트 입문 수업의 마지막 리포트를 블로그에도 정리한다. 10%의 교수님의 설명과 90%의 셀프 실습으로 이루어졌던 수업..

포기하지 말고 따라가보자는 생각으로 존버(존귀하게 버티기)했다.

첫번째 리포트 작성 땐 코랩에서 데이터 불러오기도 못하고 late를 안 받아주시는 교수님이라 세번째 리포트는 제출도 못했었는데, 마지막이었던 여섯번째 리포트는 우리 분반 안에서 best report로 뽑혀서 엑스트라 점수까지 받으며 존버에 성공한 수업이었다. 초반엔 진짜 잘못 들어왔다는 생각과 너무 힘들었는데, 팀플할 때 선배들도 잘 만나고 특히 우연히 같은 팀이었던 선배님께선 진짜 1:1 과외정도로 가르쳐주셔서 감사하게 팀플과제도 잘 마무리해서 팀플 과제 보고서도 우수 보고서로 선정해서 엑스트라 점수도 받았었다.

한번 과제를 못 제출해서 PD는 날아간 것 같지만 그래도 무사히 P를 받으며 끝났던 수업!

아래 실습 내용은 파이썬으로 data set을 직접하고 unique data들만 뽑아가며 tree를 만들었고, best report로 뽑힌 내용이다.

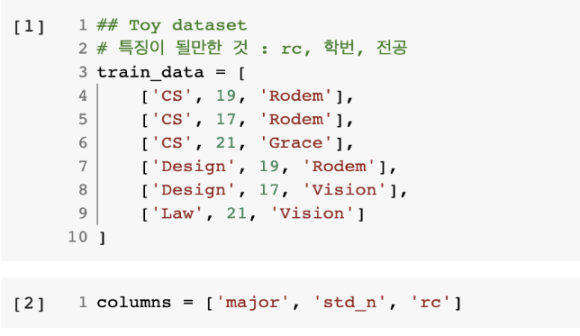

내용 1. dataset설정 후, unique value찾기

1) Make a toy dataset :

학생 데이터에서 특징이 될 만한 것들로 작성한다.

기숙사 호관(rc), 학번(std_n), 전공(major)으로 dataset 설정

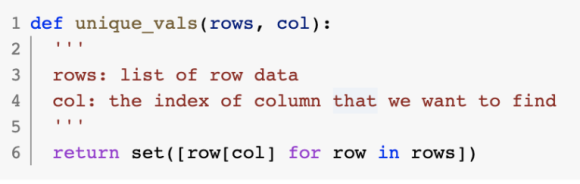

2) Make useful functions : unique value를 찾기 위한 함수를 만들어준다.

주어진 row data에서, 몇번째 columns를 return할 것인지에 대한 함수

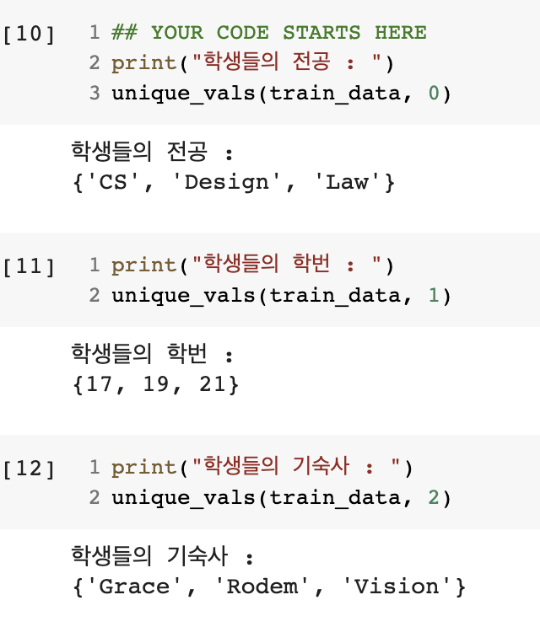

3) Finding the unique value 결과

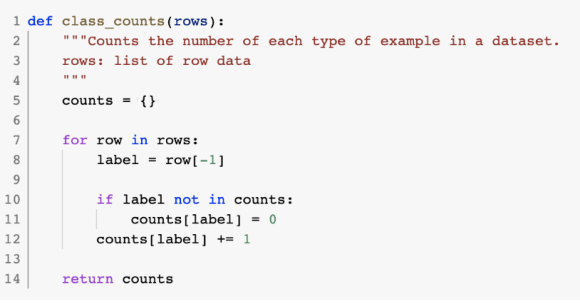

2) Make useful functions :

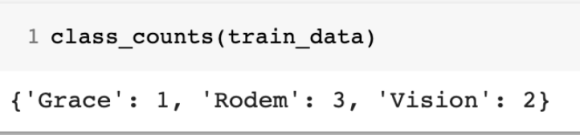

항목의 개수를 알아낼 수 있는 class_counts 함수를 만들어준다.

각 label들이 몇개인지 counts에 저장하고 마지막에 return

3) Finding the unique value 결과

: (학생)항목들에 대해서 Grace 1명, Rodem 3명, Vision 2명이라는 것을 알 수 있다.

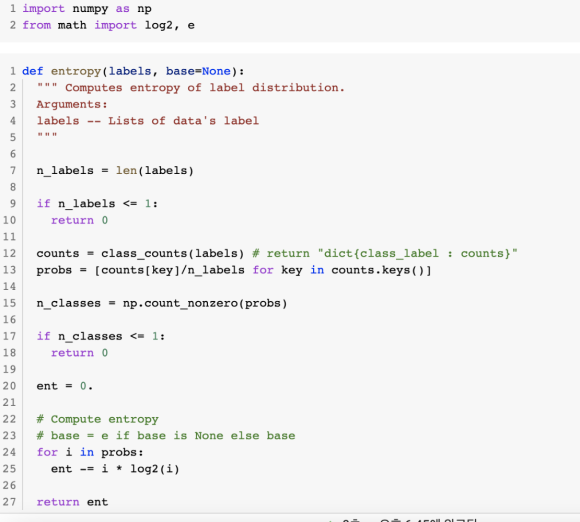

내용 2 Let's calculate "Entropy" 엔트로피 계산

1) In pure dataset, about entrpoy -> Entropy를 구하기 위한 함수 생성

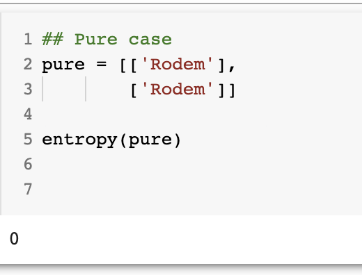

2) pure dataset 에서의 entropy value 찾기

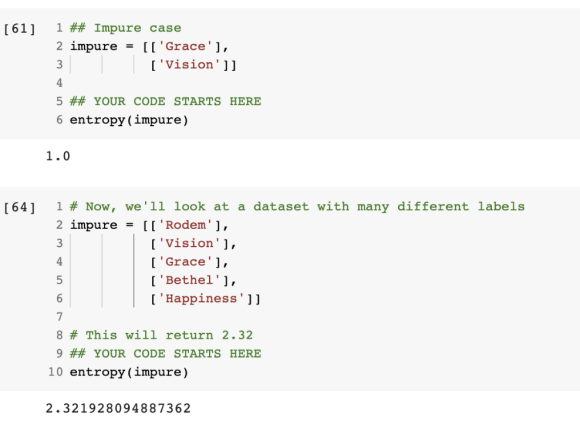

3) impure dataset 에서의 entropy value 찾기

: 첫번째는 두개뿐인의 impure dataset, 두번째는 원래 항목에 없던 항목도 추가한 impure dataset

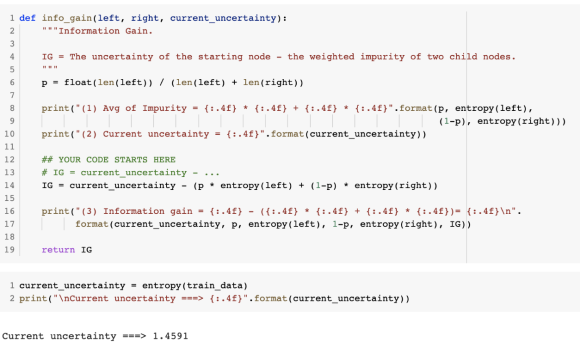

내용 3 : calculate information gain 앞서 만들어두었던 dataset을 가지고 추가 정보 얻기

- 수업 자료 mnist, tree_scratch 자료 참고

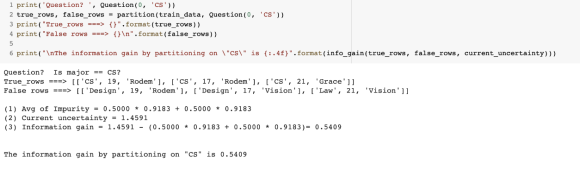

2) How much information do we gain by partitioning on 'CS'?

내가 만들어둔 dataset 항목에서 CS가 major로 저장되어 있는 것을 true rows , CS외에 다른 major가 저장된 항목들은 false rows 로 분류하고 출력문 보이도록 출력하기

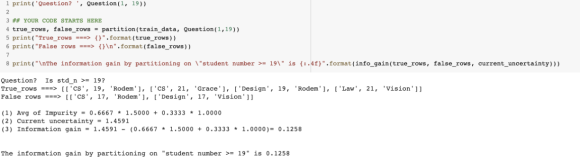

3) How much information do we gain by partitioning on student number >= 19?

주어진 자료들에서 학번이 19학번 이상인 학번(19,21)과 그렇지 않은 학번(17)을 분류하고 uncertainty 구하기

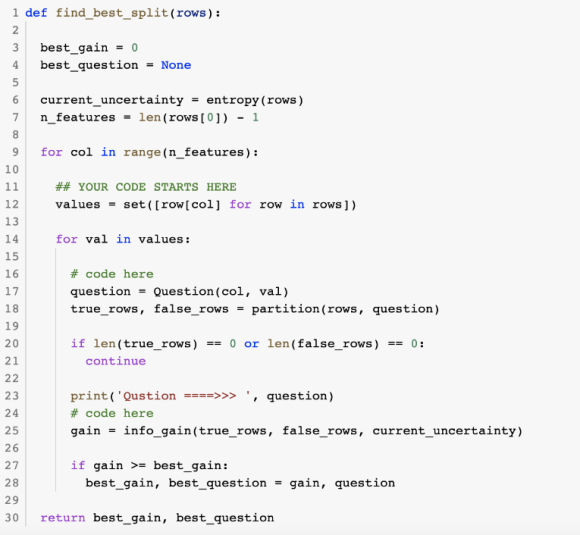

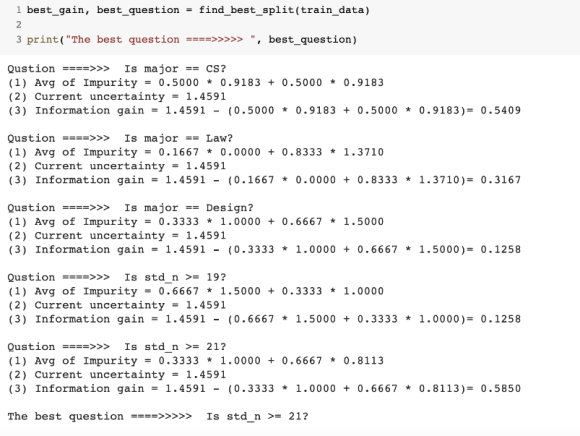

4) Find the best split based on Information Gain 정보들을 분류할 수 있는 가장 좋은 질문과 gain 찾기

- - 수업 자료 tree_scratch 자료 참고

<best question 출력>

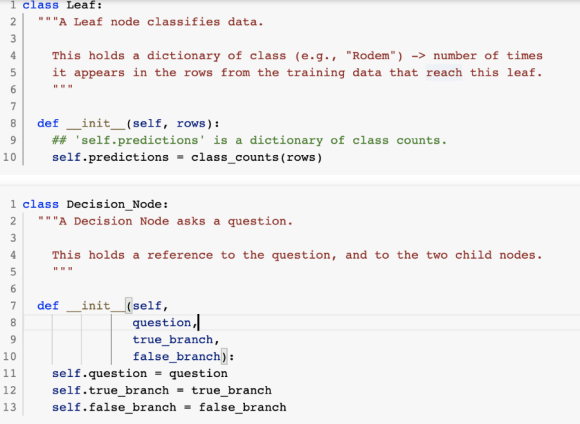

5) tree를 만들기 위해 필요한 함수들 생성

- 수업 자료 mnist, tree_scratch 자료 참고

<트리 출력문 함수 생성>

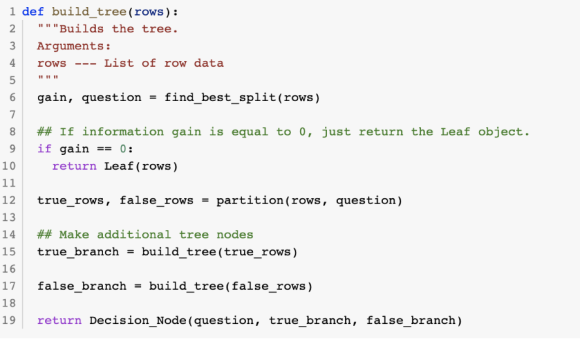

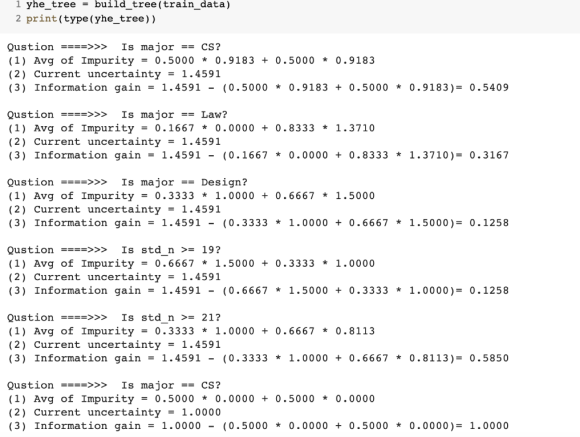

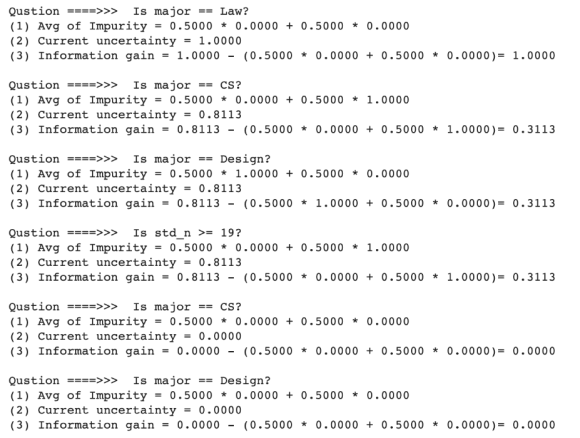

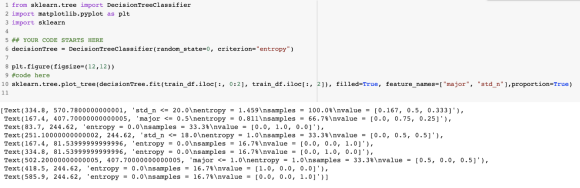

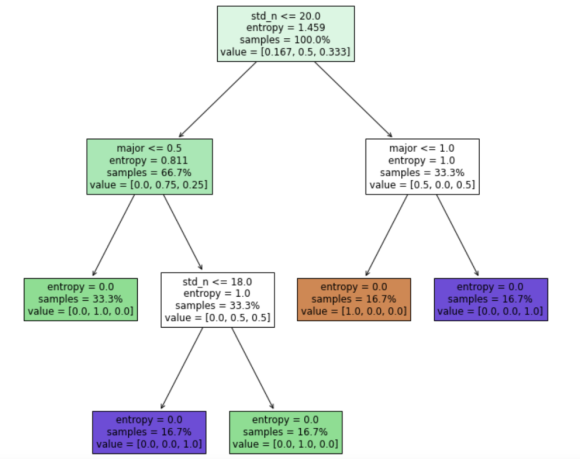

6) Let's build one Decision Tree : 트리 설계

major, std_n에 대한 question들 출력하고 계산하게 하기

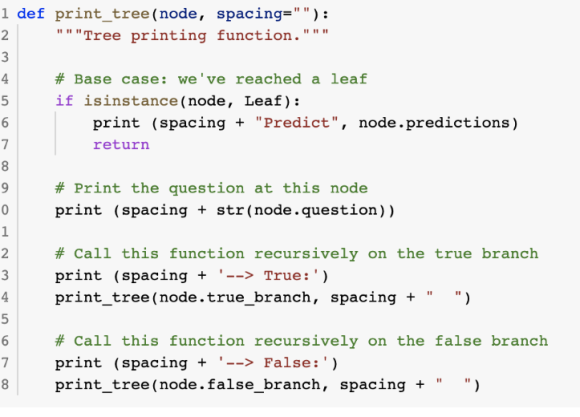

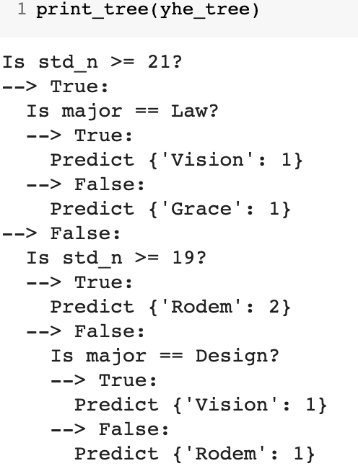

7) 트리 출력하기

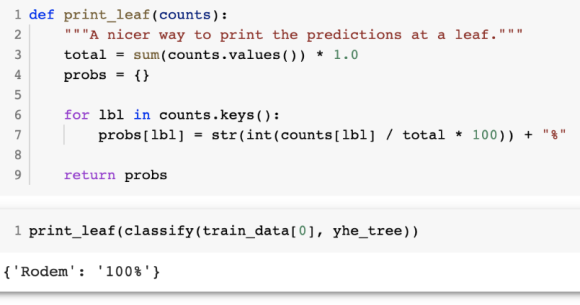

+) Which results do you get when you classify 'train_data[0]'?

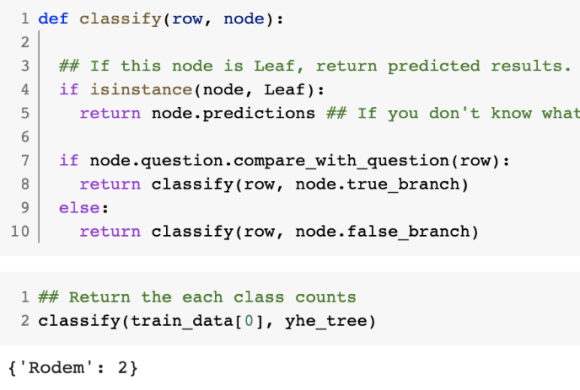

classify함수를 만들고 train_data의 [0]번째 항목에 대해서 classify적용한 결과 출력

++) Then, Which class is 'train_data[0]' classified into?

또한 train_data의[0]번째 데이터들이 어떤 클래스에 들어있는지를 분류하는 함수를 생성하고 해당 데이터가 어디 클래스에 속하는지를 출력

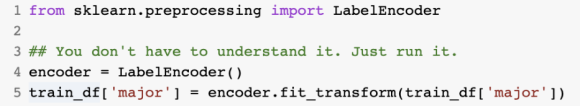

10) 마무리 : 지금까지 만들었던 함수들을 바탕으로 트리 시각화 하기

'개인 공부' 카테고리의 다른 글

| [네트워크] #01. 네트워크의 기초 (0) | 2023.08.05 |

|---|---|

| [C++] 구조체 개념 및 정의 선언 (1) | 2023.05.07 |

| [Python] random/while/list/tuple/dict (2) | 2022.09.08 |

| [Python] format (2) | 2022.08.28 |

| 개발 과제 기록/loss함수/회귀분석/Linear Regression Using Real Estate Data - sklearn Regression/Regression by Quadratic function (4) | 2022.08.26 |